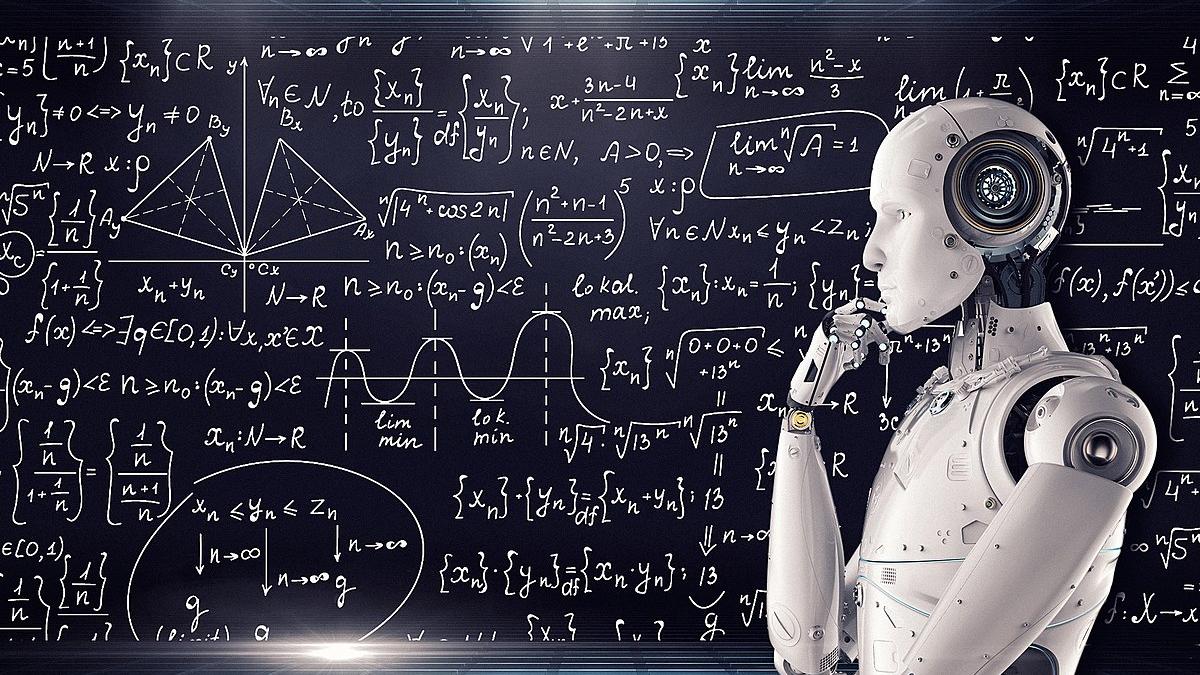

Сначала он всё делал не так. А потом научился лучше, чем человек

Не просто алгоритмы: как ИИ становится "умнее"

Сегодня искусственный интеллект уже распознаёт лица, пишет тексты, рисует картины и выигрывает у чемпионов в шахматы. Но одна из самых революционных черт современного ИИ — способность учиться на собственных ошибках, как это делает человек.

Речь не о стандартном машинном обучении, где модель просто повторяет действия. Мы говорим о системах, которые адаптируются, переоценивают свои действия и делают новые выводы.

🚧 Ошибка как двигатель развития

Идея, что ошибки полезны, кажется очевидной для человека. Мы падаем, встаём, делаем выводы. Но для машин это стало доступно лишь недавно. Долгое время ИИ не "понимал" неудачу. Он просто искал путь, который даёт максимум баллов, а не анализировал, почему допустил промах.

Современные системы, особенно с усиленным обучением (reinforcement learning), изменили это. Пример:

Робот пробует поднимать предмет, роняет его 100 раз, каждый раз меняя угол, захват, силу. Через 101 попытку он берёт его правильно — и запоминает, что сработало.

🔄 Как работает обучение на ошибках

Учёные применяют несколько подходов:

-

Итеративная обратная связь: ИИ получает данные не только о том, что хорошо, но и о том, что пошло не так. Это важно — ведь понимание ошибок формирует будущие решения.

-

Моделирование среды: вместо простых задач вроде "угадай кошку", ИИ бросают в сложные, динамичные среды, где постоянно нужно принимать решения в условиях неопределённости.

-

Методы самообучения (self-supervised learning): машина сама находит закономерности, без точных указаний человека. Ошибка тут — часть процесса.

🧪 Ошибка ≠ провал

Инженеры сознательно создают условия, в которых ИИ должен ошибаться, чтобы научиться:

-

Играя в игры, он пробует тысячи стратегий — большинство не работает, но именно они закаляют алгоритм.

-

Обучая нейросети создавать речь, разработчики дают им примеры с шумом, помехами и нелогичными ответами — чтобы те адаптировались к реальности.

-

В медицинских ИИ врачи "скармливают" случаи неправильных диагнозов — чтобы машина училась видеть тонкие отличия.

🤖 А может ли ИИ сожалеть?

Некоторые лаборатории идут ещё дальше — они экспериментируют с алгоритмами, которые пытаются "осознать" свои действия через внутреннюю модель целей и последствий. Это не эмоции, как у человека, но приближение к рефлексии.

Интересный эксперимент провели учёные из Университета Дипмайнд: ИИ играл в игру, где слишком агрессивная стратегия вела к провалу в будущем. Модель научилась действовать осторожнее, потому что "помнила", что ошибка приводит к проигрышу позже.

🧭 Почему это важно

Способность учиться на ошибках — один из главных шагов к созданию по-настоящему адаптивного ИИ, который сможет:

-

работать в реальном мире, а не в идеальных лабораториях;

-

взаимодействовать с людьми, где постоянно возникают "нетипичные" ситуации;

-

принимать решения там, где нет чёткой инструкции - как, например, в экстренной медицине или при аварийном вождении.

🔚 В чём парадокс

ИИ, чтобы стать "умным", должен сначала быть "глупым". Он не может научиться, если не ошибается. Это возвращает нас к простой, но мощной идее: ошибки — не слабость, а инструмент роста.

Подписывайтесь на Экосевер